Пока одна часть интернета полностью переформатировалась под алгоритмы и просмотр контента в режиме бесконечной ленты, вторая неизбежно и уверенно наполняется ИИ-контентом разной степени искусственности, простите за каламбур.

Но больше всего видно, как ИИ потихоньку убивает некоторые форматы контента и поднимает градус ненависти к интернету у пользователей. Сегодня об этом и поговорим.

А помните, как когда-то мэшапы делали руками?

Что такое «мэшап», спросите вы? Ну вот выше был самый эталонный и ранний пример. Звучит очень органично, красиво и, кажется, в свое время даже исполнялось с похожей аранжировкой вживую. Другими словами, мэшап — это музыкальное творчество, когда смешивают вместе пару произведений в формате «как есть», а не перепевают или каким-то образом делают кавер.

То есть, например, из одного трека берется вокал, а из другого — музыка и вручную (это очень кропотливая работа) сводится до такого уровня, что ты слушаешь и думаешь, что оно так и должно быть. Максимально органично, другими словами.

И вот чем сильнее развивается индустрия ИИ, тем больше она убивает культуру вручную созданных крутых мэшапов. YouTube и TikTok сейчас просто переполнены сделанными с помощью ИИ песнями уровня «Черный Бумер», но это поет Modern Talking.

Подобное «творчество» делается через Udio AI, не требует затрат по времени и усилиям и, что самое страшное, звучит пугающе похоже на созданный вручную контент формата «по-старинке». Понятное дело, хороших мэшап-музыкантов ИИ никогда не заменит, но засоряемость ленты подобным нейроконтентом (особенно про одну всем известную машину, которую 40 лет как под наркозом водят) уже откровенно раздражает.

Засилье желтого цвета, оскорбление наследия великого аниме и в целом картинки уже всех достали

Не так давно мы все весело шутили про эпоху «желтого фильтра» в игровой индустрии середины-конца «нулевых», кто же знал, что она вернется в такой довольно странной ипостаси. Весной 2025 года у ChatGPT случилось глобальное обновление генератора картинок, и интернет захлестнула волна нейроарта.

Сначала появился совершенно отвратительный тренд на картинки в стиле аниме-студии Ghibli. Многие юзеры интернета очень справедливо отметили, что подобный ИИ-арт, в общем-то, можно расценивать как плевок в лицо художникам, что вырабатывали стиль годами как минимум, а как максимум — это неплохой такой заход на территорию гарантированного нарушения авторских прав.

А еще конкретно в примере с Ghibli есть один интересный момент — экология. Нейросети требуют огромных вычислительных мощностей, что приводит к высокому энергопотреблению и в целом загрязнению природы, а почти все фильмы Миядзаки так или иначе проблемам экологии и сохранения природы.

Но хуже подобного неуважения только однотипные ИИ-иллюстрации, которые сейчас везде — от социальных сетей до буквально базовых товаров в магазинах. Не так давно я покупал дочери блокнот и откровенно устал искать нормальный без аниме-обложки, сделанной в дешевой бесплатной нейронке.

Про засилье картинок из ChatGPT, где один и тот же шрифт, стоковые стили примерно всего на картинке и самое главное — навязчивый желтый фильтр, вообще молчу.

Ну и никуда без развода для пенсионеров. В основном этим, правда, занимаются в соцсети Марка Цукерберга, но все же — в 2024-м заметили, что соцсеть просто переполнена фейковыми картинками про «посмотрите на этих бабушек-близняшек, они вместе всю жизнь!» и прочей подобной сентиментальной пожалейкой.

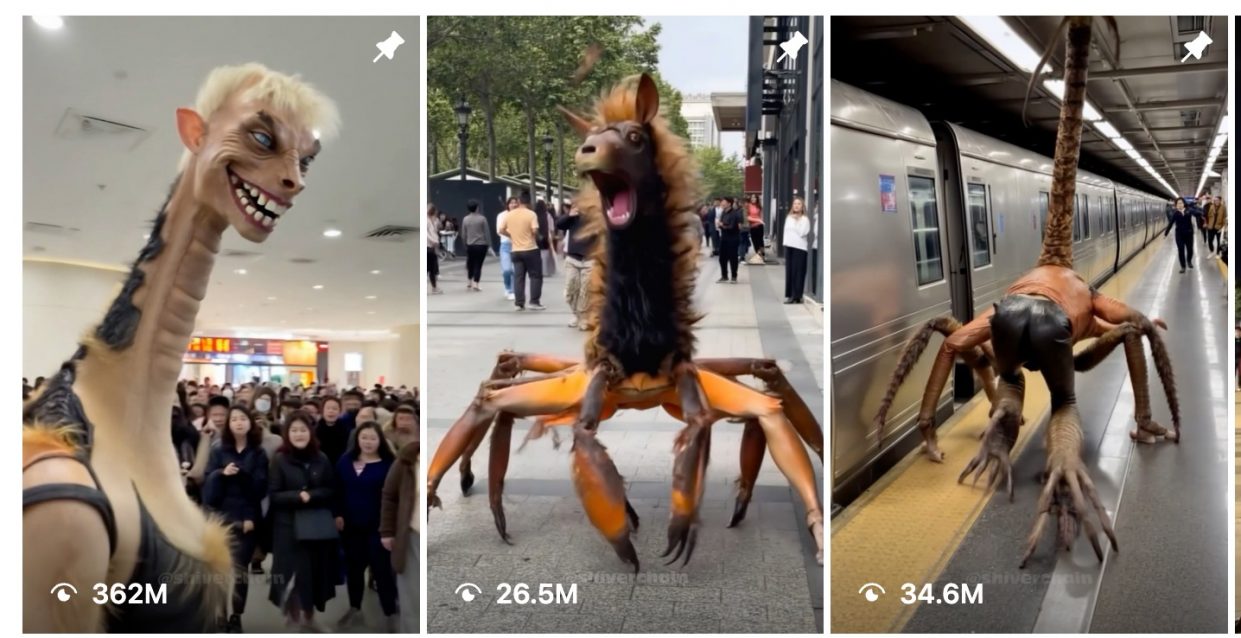

И, конечно, без откровенного больного боди-хоррора, поданного под соусом чего-то реального, тоже не обходится, но это хотя бы весело, если честно.

«Грок, это правда?» в качестве ультимативного аргумента

То, о чем я буду говорить ниже, глобально актуально только для одной конкретной соцсети, где ИИ можно вызывать прямо в реплаях, но тенденция подобного использования так или иначе начинает просачиваться в дискуссии по всему интернету.

О чем речь: есть такой Grok, ИИ от Илона Маска, интегрированный в запрещенную на территории РФ соцсеть X (да-да, бывший Twitter), и одна из главных его инноваций заключается в том, что Грока, в общем-то, можно притягивать в любой диалог ради фактчекинга практически любой информации. И ладно ПЕРВЫЕ ПЯТЬ РАЗ ЭТО БЫЛО СМЕШНО, потому что Грок непредсказуем и иногда выдает откровенно абсурдные штуки, особенно в вопросах политики.

Не смешно стало, когда люди на полном серьезе стали всю дискуссию строить на битве аргументов от Грока. То есть как это выглядит: человек пишет аргумент, другой фактчекает его у Грока и выдает контраргумент, и так повторяется, пока Грок не начнет (а он начнет) нести дискредитирующую юзера информацию. А еще уже как минимум пару раз такие дискуссии провоцировали мировые скандалы, потому что Грок… Ладно, не будем нарушать закон.

Страшнее только выглядит то, что я лично стал замечать, как люди подобный формат дискуссии начали тянуть и в другие социальные сети, только вместо уже ставшего мемом «Грок, это правда?» в качестве оружия используются скриншоты из ChatGPT.

Контент-фермы из стран Азии это проблема

В конце прошлого года интернет сначала сильно умилялся, потом, наверное, рыдал, но в конце концов уж точно ужасался роликам формата Cute Cats. Что это было — лавина нейросетевых роликов про жизнь на первый взгляд милых котяток под грустную музыку, в сюжете которых вечно происходит какой-то бразильский сериал с изменами, брошенными детьми и так далее. И всё это было ну прямо очень плохо сгенерировано через дешевые нейросети.

Только вот градус шизофрении в тех видео со временем стал расти в геометрической прогрессии, от похорон после аварии до снова какого-то боди-хоррора про котят с эстетикой прославления болезней и увечий. Весь TikTok был завален этим кошмаром, с которым вроде как наконец-то начали бороться.

Известно, что большинство этого мусора генерируется где-то в Индонезии, Тайланде и Пакистане. По сети так или иначе ходят ролики из мутного вида офисов, где «промпт-специалисты» сутками корпят над крайне виральными и хорошо монетизуемыми видео про милых котиков. И да, засилье подобного контента — это проблема. Рыдающие дети, что случайно на него наткнулись, соврать не дадут.

Нейро-слоп опасен, особенно в умелых руках

А знаете, что самое главное? С развитием ИИ всё это становится правдоподобнее, и иногда ролики из Sora 2 без вотермарки отличить от настоящих уже почти невозможно. Да и недавно хайпанувшие «интервью» из Veo 3 тоже во многом выглядят уж слишком реалистично.

Чем это опасно? Да тем, что рано или поздно кто-то научится делать нейро-видео еще реалистичнее, найдет хороший инструмент вырезания вотермарок, и тогда наше информационное поле станет еще более небезопасным, неэтичным и переполненным дезинформацией. По любым поводам, а не только по политическим.

С этой мыслью вас и оставляю. Хорошего дня!

15 комментариев