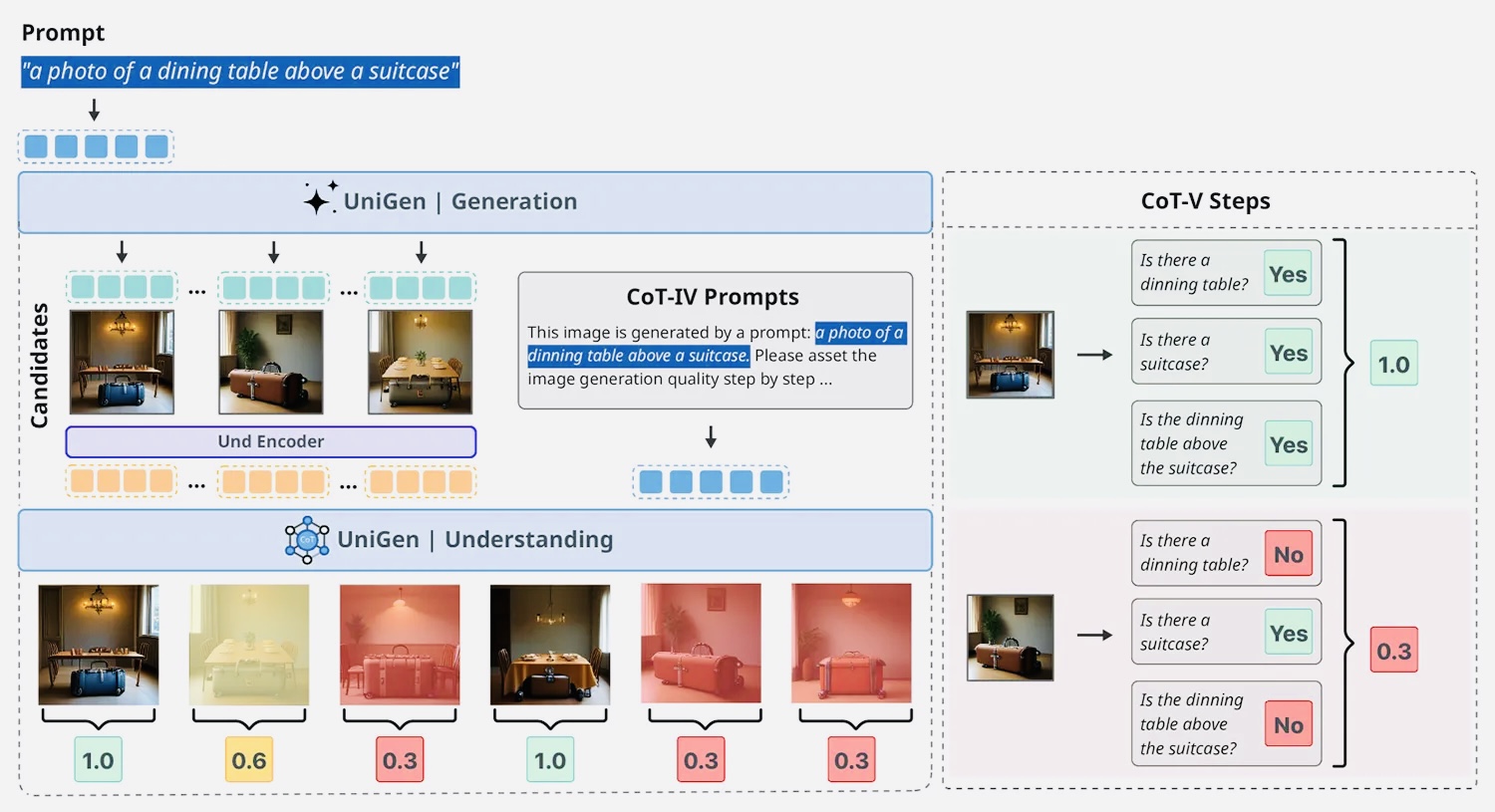

Команда Apple Research представила UniGen 1.5 — универсальную ИИ-модель, способную одновременно понимать, генерировать и редактировать изображения. UniGen 1.5 строится на базе предыдущей версии UniGen, которая сочетала способности визуального понимания (анализ изображений) и генерации картинок в одной версии.

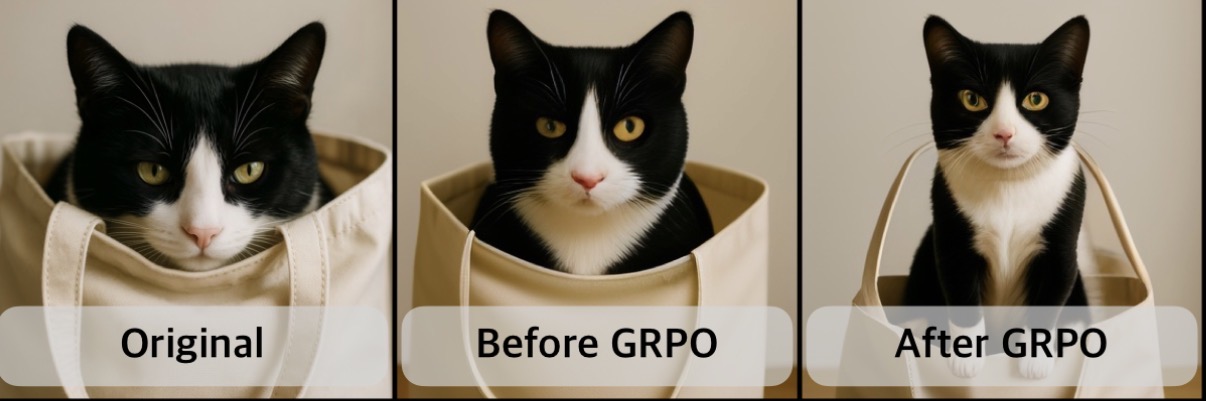

По мере развития модели исследователи столкнулись с тем, что разные задачи имеют разные требования, и объединить их в одну систему сложно. Чтобы решить это, Apple ввела новый этап обучения под названием Edit Instruction Alignment. Это механизм, который помогает модели сначала интерпретировать намерение пользователя на уровне текста, прежде чем переходить к непосредственным визуальным изменениям.

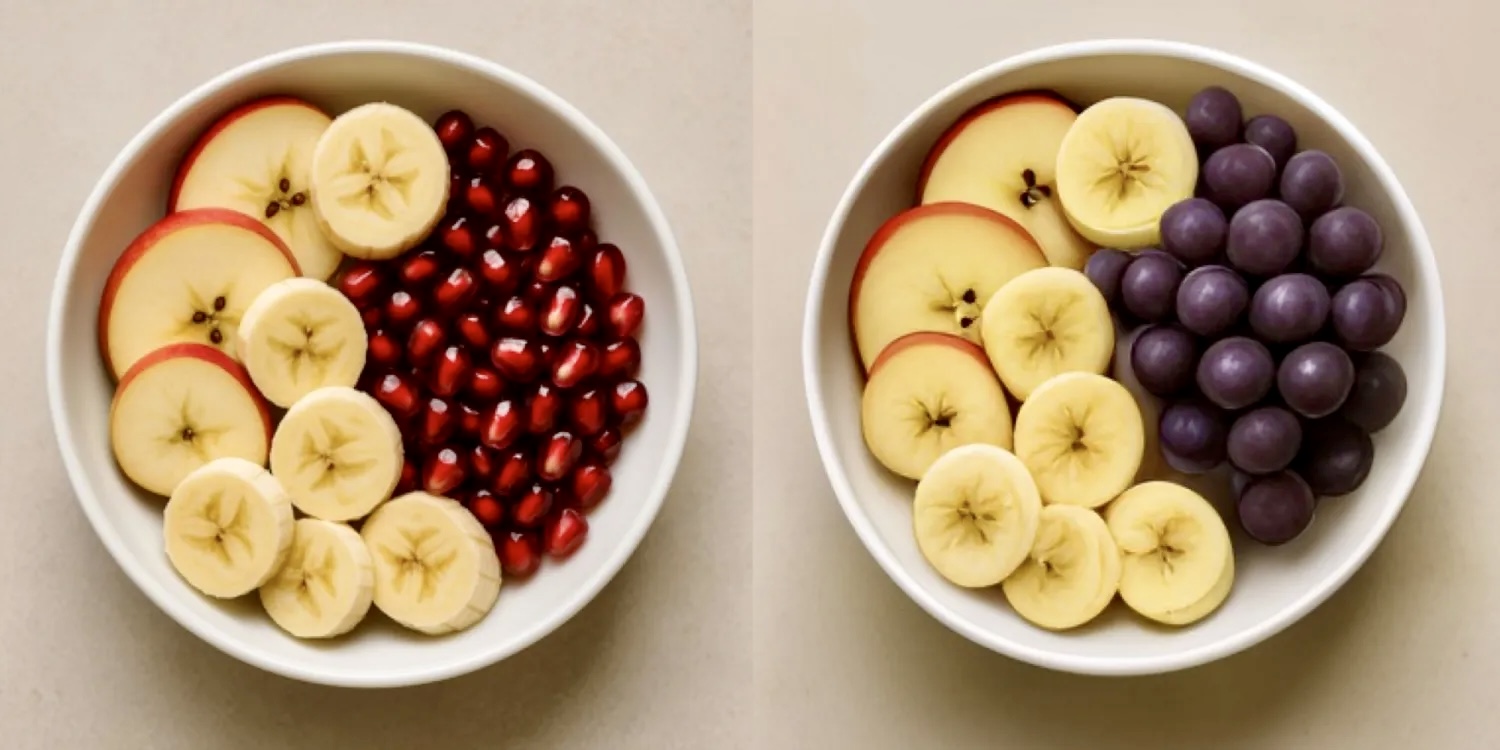

В этой схеме UniGen-1.5 получает исходное изображение и инструкцию (например: «убрать фон и изменить цвет объекта»), затем формирует текстовое описание желаемого результата, которое помогает точнее выполнить финальное редактирование.

В тестах на стандартных наборах данных по трём задачам UniGen 1.5 либо сравним по качеству, либо превосходит многие современные мультимодальные ИИ-модели.

Тем не менее, этой модели всё ещё сложно корректно обрабатывать структуры текста в картинках (например, надписи), а в некоторых примерах с редактированием теряется идентичность объектов, например в текстуре или форме элементов.

UniGen 1.5 является внутренним проектом Apple, поэтому протестировать её нельзя. [9to5]

3 комментария