Apple представила новые функции доступности, которые с появятся позже в этом году.

Среди них: метки доступности в App Store, новое приложение Лупа для Mac, функция Braille Access и Accessibility Reader, а также обновления для Live Listen, visionOS, Personal Voice и других возможностей.

Что нового?

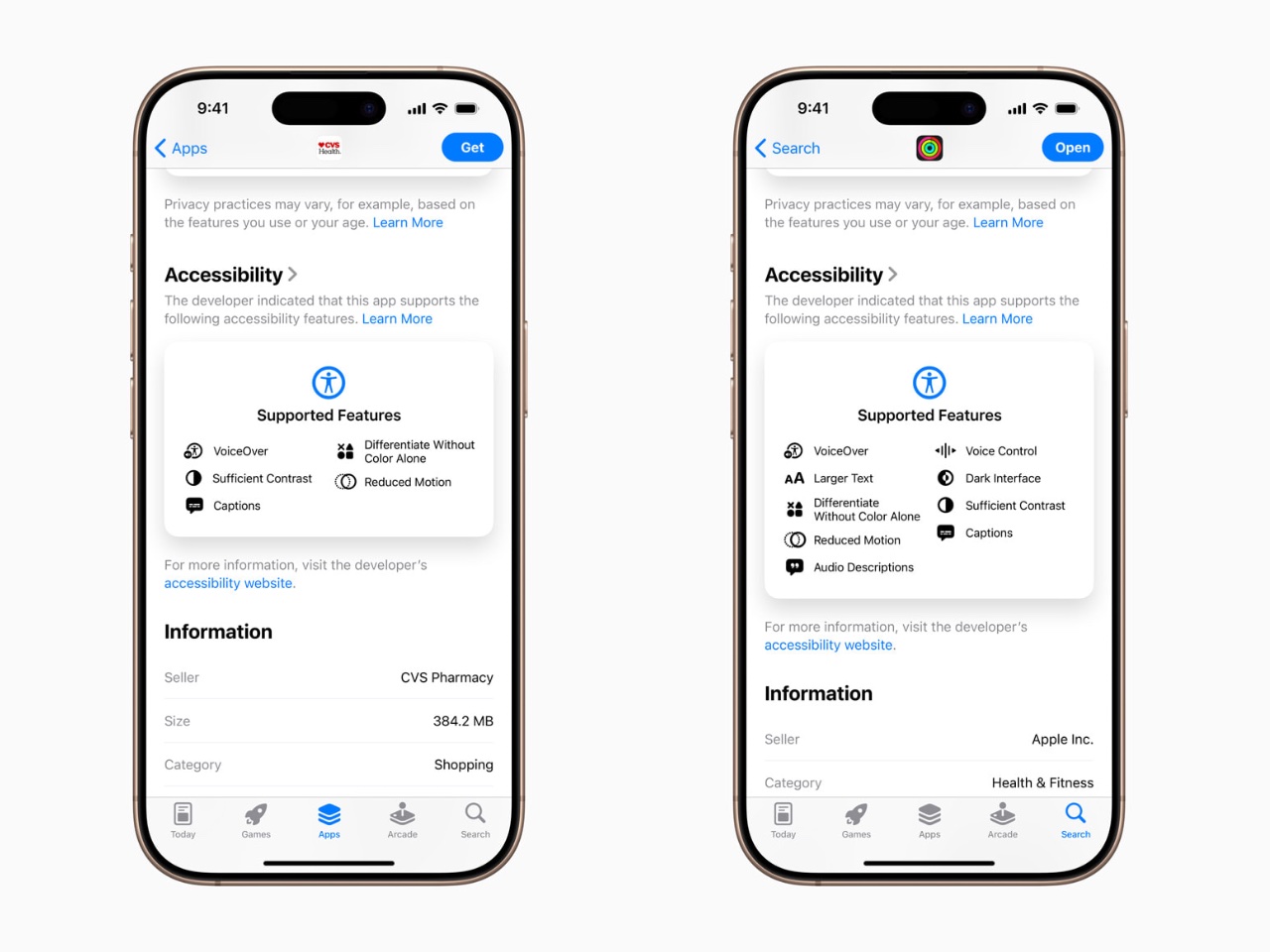

Метки доступности в App Store

Метки доступности (Accessibility Nutrition Labels) появятся на страницах приложений и игр в App Store, предоставляя пользователям подробную информацию о поддерживаемых функциях, вроде VoiceOver, Voice Control, увеличенного текста, достаточного контраста, уменьшенного движения и субтитры.

Это поможет людям с ограниченными возможностями заранее узнать, подходит ли приложение, а разработчикам — лучше информировать пользователей.

Лупа для Mac

Приложение Лупа появится на Mac. Оно позволит людям с нарушениями зрения увеличивать изображение окружающих объектов, используя камеру компьютера, Continuity Camera на iPhone или USB-камеры. Поддерживается чтение документов через Desk View, настройка яркости, контраста, цветовых фильтров и перспективы, а также интеграция с новой функцией Accessibility Reader.

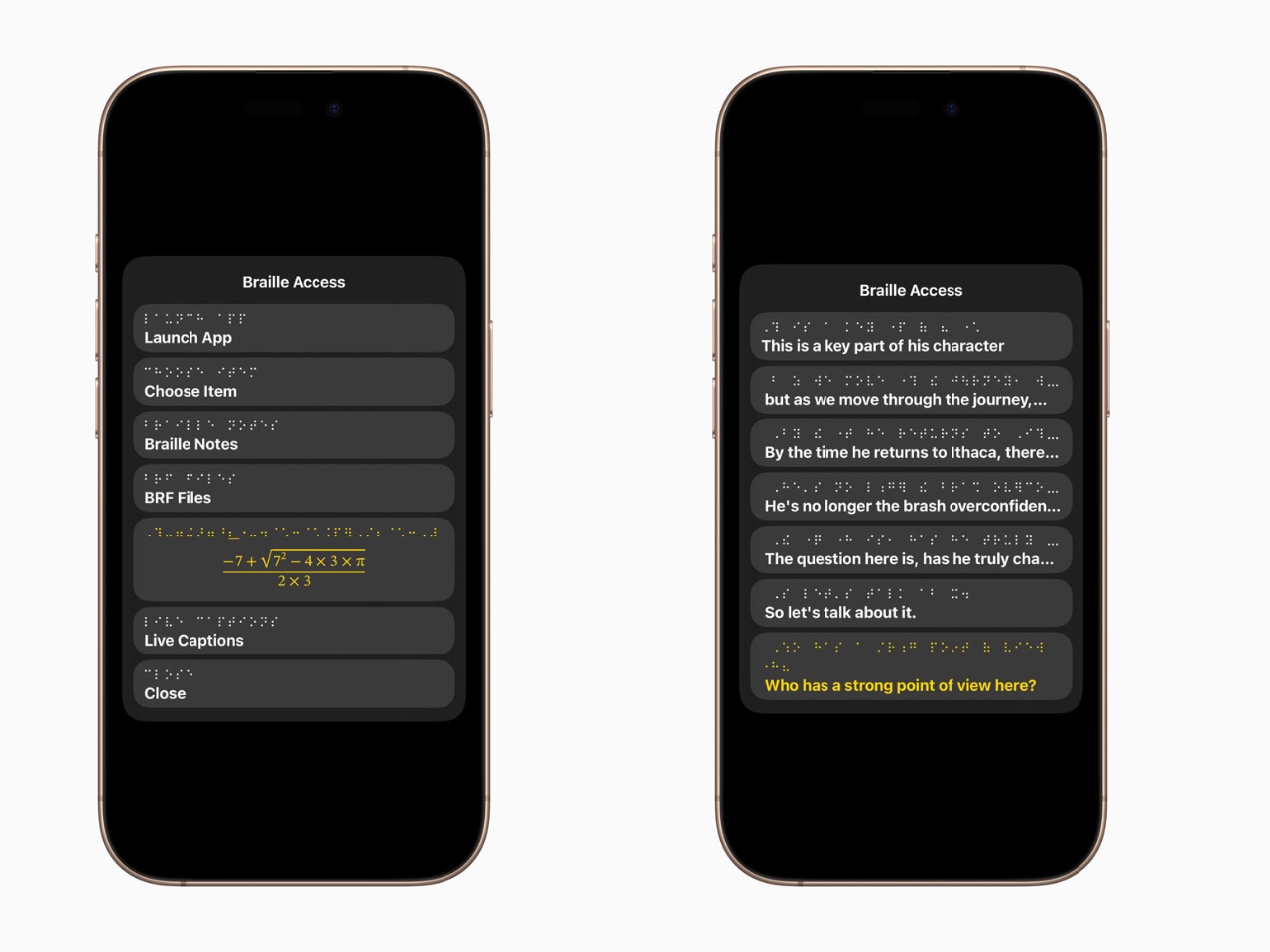

Новая функция Braille Access

Функция Braille Access превратит iPhone, iPad, Mac и Apple Vision Pro в «мощные брайлевские устройства для заметок». Пользователи смогут запускать приложения с помощью брайлевского ввода или подключенного устройства, делать заметки, выполнять вычисления с использованием кода Немета и открывать файлы в формате BRF.

Также появится поддержка живых субтитров на брайлевских дисплеях.

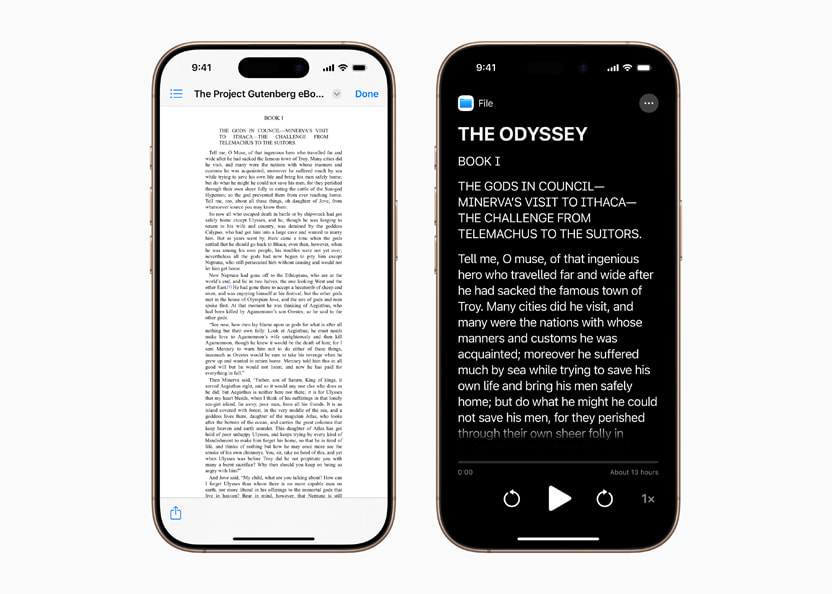

Accessibility Reader

Accessibility Reader — новый системный режим чтения для пользователей с дислексией или нарушениями зрения. Он будет доступен на iPhone, iPad, Mac и Apple Vision Pro.

Нововведение позволяет настраивать шрифт, цвет и межбуквенное расстояние, а также поддерживает функцию озвучивания текста. Режим интегрирован с Лупой для чтения текста из реального мира, например, из книг или меню.

«Живые субтитры» на Apple Watch

Функция Live Listen появится на Apple Watch с поддержкой живых субтитров в реальном времени. iPhone выступает в роли удаленного микрофона, передавая звук на AirPods, слуховые аппараты или наушники Beats, а субтитры отображаются на часах.

Пользователи могут управлять сессиями Live Listen удаленно, что удобно в классе или на собрании.

Обновления для Apple Vision Pro

В visionOS появятся улучшения для пользователей с нарушениями зрения:

• функция Zoom позволит увеличивать изображение с основной камеры

• Live Recognition поможет описывать окружающую среду, находить объекты и читать документы

Новый API позволит приложениям, таким как Be My Eyes, использовать камеру для визуальной помощи.

И по мелочи

• Background Sounds: новые настройки эквалайзера, таймер автоотключения и интеграция с Shortcuts

• Personal Voice: создание более естественного голоса за минуту с использованием 10 фраз, поддержка испанского (Мексика)

• Vehicle Motion Cues: функция против укачивания появится на Mac с настраиваемыми анимациями

• Eye Tracking и Switch Control: улучшения для выбора и ввода текста на iPhone, iPad и Apple Vision Pro

• Head Tracking: управление устройствами движениями головы

• Switch Control для BCI: поддержка интерфейсов мозг-компьютер

• Assistive Access: упрощенное приложение Apple TV и API для разработчиков

• Music Haptics: настройка тактильной обратной связи для песен или вокала

• Sound Recognition: распознавание имени пользователя

• Voice Control: новый режим программирования в Xcode, синхронизация словаря и поддержка новых языков

• Live Captions: поддержка новых языков, включая английский (Индия, Австралия, Великобритания, Сингапур), китайский, испанский, французский, японский, немецкий и корейский

• CarPlay: поддержка увеличенного текста и распознавание звука плача ребенка

• Share Accessibility Settings: временный перенос настроек доступности на другое устройство

Все эти нововведения появятся до конца 2025 года.

8 комментариев